Chaque fois que vous ouvrez une application, lancez un jeu vidéo ou naviguez sur internet, votre appareil doit effectuer une grande quantité de calculs en quelques fractions de seconde. Derrière toutes ces opérations se trouve un composant essentiel : le processeur, souvent appelé CPU (Central Processing Unit).

Le processeur est généralement considéré comme le cerveau de l’ordinateur. C’est lui qui exécute les instructions des programmes, effectue les calculs et coordonne le fonctionnement des différents composants de la machine. Sans lui, un ordinateur, un smartphone ou une tablette serait incapable de traiter la moindre information.

Malgré son rôle central, le fonctionnement d’un processeur reste souvent mal compris. Comment peut-il exécuter des milliards d’opérations chaque seconde ? Comment transforme-t-il des instructions logicielles en actions concrètes ? Et quels sont les éléments qui influencent réellement ses performances ?

Qu’est-ce qu’un processeur ?

Le processeur est l’un des composants les plus importants d’un ordinateur. Son rôle principal est d’exécuter les instructions des programmes et de traiter les informations nécessaires au fonctionnement du système.

Concrètement, chaque logiciel que vous utilisez, qu’il s’agisse d’un navigateur web, d’un traitement de texte ou d’un jeu vidéo, est composé d’une grande série d’instructions. Ces instructions indiquent à l’ordinateur les opérations à effectuer, comme réaliser un calcul, comparer des valeurs ou déplacer des données en mémoire. Le processeur est chargé de lire ces instructions et de les exécuter une par une.

Pour effectuer ces tâches, le processeur réalise en permanence de nombreuses opérations logiques et mathématiques. Il peut par exemple additionner des nombres, comparer des valeurs ou prendre des décisions simples en fonction de certaines conditions. Toutes ces opérations permettent au système d’exécuter les programmes et de faire fonctionner l’ordinateur.

On compare souvent le processeur au cerveau de l’ordinateur. Cette comparaison est utile pour comprendre son rôle : comme un cerveau qui traite des informations et prend des décisions, le processeur analyse les instructions et détermine les actions à effectuer.

Aujourd’hui, les processeurs sont présents dans une grande variété d’appareils : ordinateurs, smartphones, consoles de jeux, objets connectés ou encore voitures modernes. Même si leur puissance et leur architecture peuvent varier, leur objectif reste le même : traiter des informations et exécuter des instructions le plus rapidement possible.

Les composants principaux d’un processeur

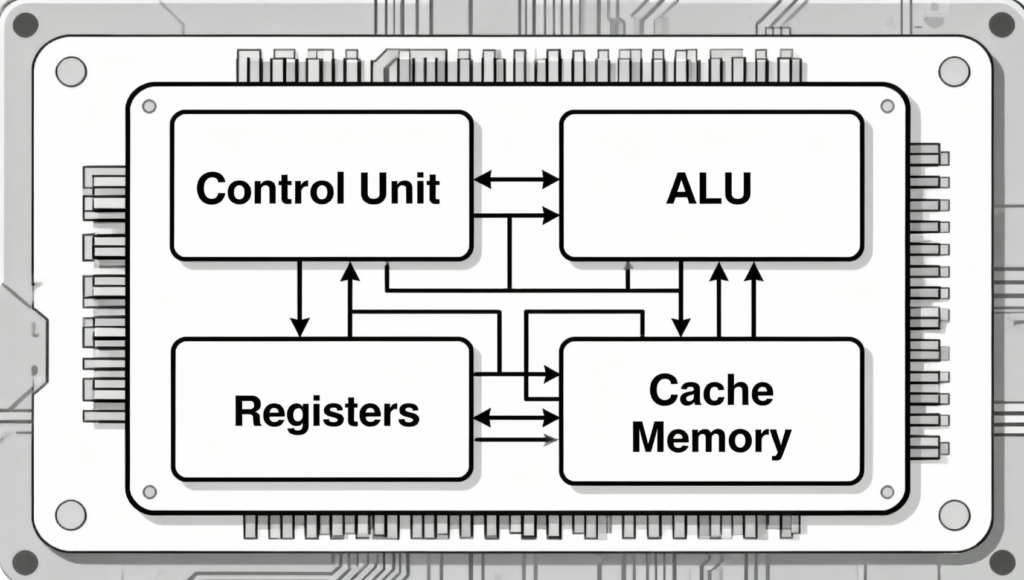

Pour exécuter les instructions des programmes, un processeur s’appuie sur plusieurs composants internes, chacun ayant un rôle bien précis. Même si les architectures modernes sont très complexes, on peut comprendre le fonctionnement d’un processeur en se concentrant sur quelques éléments essentiels.

L’un des composants les plus importants est l’unité de contrôle (Control Unit). Son rôle est d’organiser le travail du processeur. Elle récupère les instructions stockées en mémoire, les interprète et indique aux autres parties du processeur quelles opérations doivent être effectuées. En quelque sorte, elle agit comme un chef d’orchestre qui coordonne l’exécution des différentes tâches.

Un autre élément central est l’unité arithmétique et logique, souvent appelée ALU (Arithmetic Logic Unit). Cette unité est responsable des calculs réalisés par le processeur. Elle peut effectuer des opérations mathématiques comme des additions ou des soustractions, mais aussi des opérations logiques, par exemple comparer deux valeurs ou vérifier si une condition est vraie ou fausse.

Le processeur contient également de petits espaces de stockage appelés registres. Les registres servent à conserver temporairement des données ou des résultats intermédiaires pendant l’exécution des instructions. Ils sont extrêmement rapides et permettent au processeur d’accéder immédiatement aux informations dont il a besoin.

Enfin, les processeurs modernes intègrent généralement une mémoire cache. Cette mémoire très rapide stocke certaines données ou instructions fréquemment utilisées afin d’éviter d’aller les chercher dans la mémoire principale de l’ordinateur, qui est plus lente. Le cache permet ainsi d’accélérer l’exécution des programmes et d’améliorer les performances globales du système.

Ces différents composants travaillent ensemble en permanence pour permettre au processeur de lire les instructions des programmes, d’effectuer les calculs nécessaires et de coordonner le fonctionnement de l’ordinateur.

Le cycle d’exécution des instructions

Pour exécuter les programmes, le processeur suit un processus appelé cycle d’exécution des instructions. Ce cycle correspond à une série d’étapes que le processeur répète en permanence afin de lire et d’exécuter les instructions contenues dans un programme.

Ce cycle est généralement décrit en trois étapes principales : fetch, decode et execute.

La première étape est appelée fetch (ou récupération de l’instruction). Le processeur va chercher la prochaine instruction à exécuter dans la mémoire de l’ordinateur. Cette instruction est ensuite chargée dans un registre interne afin que le processeur puisse la traiter.

La deuxième étape est le decode (ou décodage). À ce moment-là, le processeur analyse l’instruction récupérée afin de comprendre quelle opération doit être effectuée. Il identifie par exemple s’il doit réaliser un calcul, déplacer des données ou comparer certaines valeurs.

Enfin vient l’étape execute (ou exécution). Le processeur réalise l’opération demandée par l’instruction. Cela peut être un calcul effectué par l’unité arithmétique et logique, un transfert de données ou encore une modification de certaines valeurs en mémoire.

Une fois l’instruction exécutée, le processeur passe immédiatement à la suivante et répète ce cycle encore et encore.

Grâce à ce cycle d’exécution extrêmement rapide, le processeur peut traiter un grand nombre d’instructions et faire fonctionner simultanément les différents programmes utilisés sur un ordinateur.

Le rôle de l’horloge du processeur

Pour fonctionner correctement, le processeur doit suivre un rythme précis qui coordonne l’exécution des différentes opérations. Ce rythme est défini par un élément appelé l’horloge du processeur.

L’horloge génère des impulsions électriques régulières qui servent de repère pour synchroniser les actions du processeur. À chaque impulsion, appelée cycle d’horloge, le processeur peut effectuer une ou plusieurs étapes du traitement des instructions.

La vitesse de cette horloge est appelée fréquence d’horloge. Elle est généralement exprimée en hertz (Hz), une unité qui indique le nombre de cycles effectués par seconde. Dans les processeurs modernes, cette fréquence se mesure souvent en gigahertz (GHz). Par exemple, un processeur cadencé à 3 GHz peut effectuer environ trois milliards de cycles par seconde.

Plus la fréquence d’horloge est élevée, plus le processeur peut théoriquement exécuter d’opérations dans un laps de temps donné. C’est pourquoi la fréquence a longtemps été considérée comme un indicateur important des performances d’un processeur.

Cependant, la fréquence d’horloge ne suffit pas à elle seule à déterminer la puissance d’un processeur. D’autres facteurs entrent également en jeu, comme l’architecture du processeur, le nombre de cœurs, la taille du cache ou encore l’efficacité des circuits internes.

Aujourd’hui, les fabricants cherchent à trouver un équilibre entre performance, consommation d’énergie et production de chaleur. Augmenter la fréquence permet d’améliorer les performances, mais cela entraîne aussi une consommation électrique plus élevée et une chaleur plus importante, ce qui peut limiter les gains possibles.

Les cœurs et le traitement parallèle

Les processeurs modernes ne se contentent plus d’exécuter les instructions une par une avec un seul cœur. Aujourd’hui, la plupart des processeurs possèdent plusieurs cœurs, ce qui leur permet de traiter plusieurs tâches en même temps.

Un cœur peut être considéré comme un processeur miniature intégré à l’intérieur du processeur principal. Chaque cœur est capable d’exécuter ses propres instructions et de réaliser des calculs de manière indépendante. Par exemple, un processeur quad-core possède quatre cœurs capables de travailler simultanément.

Cette approche permet de mettre en place ce que l’on appelle le traitement parallèle. Au lieu de traiter toutes les tâches les unes après les autres, le système peut répartir le travail entre plusieurs cœurs. Cela permet d’améliorer les performances, notamment lorsque plusieurs programmes sont utilisés en même temps.

Par exemple, pendant que l’un des cœurs exécute un logiciel, un autre peut gérer le système d’exploitation, tandis qu’un troisième peut traiter une autre application en arrière-plan. Cette répartition des tâches rend l’ordinateur plus fluide et plus réactif.

Les logiciels modernes sont également conçus pour exploiter cette capacité de calcul parallèle. Certains programmes, comme les logiciels de montage vidéo, de rendu 3D ou de calcul scientifique, peuvent diviser leur travail en plusieurs parties afin de les distribuer sur différents cœurs du processeur.

Grâce à cette évolution vers les processeurs multicœurs, les ordinateurs peuvent aujourd’hui exécuter un grand nombre de tâches simultanément tout en conservant de bonnes performances.

Le cache du processeur

Pour fonctionner efficacement, un processeur doit accéder en permanence à des données et à des instructions stockées en mémoire. Cependant, la mémoire principale de l’ordinateur, appelée RAM, est relativement plus lente que le processeur. Si le processeur devait attendre la RAM à chaque opération, les performances de l’ordinateur seraient fortement limitées.

Pour réduire ce problème, les processeurs utilisent une mémoire cache. Il s’agit d’une petite mémoire extrêmement rapide intégrée directement dans le processeur ou très proche de celui-ci. Son rôle est de stocker temporairement les données et les instructions les plus fréquemment utilisées.

Lorsque le processeur a besoin d’une information, il commence par vérifier si celle-ci se trouve dans le cache. Si c’est le cas, il peut y accéder beaucoup plus rapidement que s’il devait aller la chercher dans la mémoire principale. Cela permet de réduire les temps d’attente et d’améliorer les performances globales du système.

Les processeurs modernes utilisent généralement plusieurs niveaux de cache :

- Cache L1 : très rapide mais de petite taille, directement intégré dans chaque cœur du processeur.

- Cache L2 : un peu plus grand mais légèrement plus lent que le cache L1.

- Cache L3 : encore plus grand et souvent partagé entre plusieurs cœurs du processeur.

Grâce à ces différents niveaux de cache, le processeur peut accéder rapidement aux données dont il a le plus souvent besoin. Ce mécanisme joue un rôle essentiel dans les performances des processeurs modernes, car il permet de limiter les accès à la mémoire principale, beaucoup plus lente.

L’architecture des processeurs

L’architecture d’un processeur désigne l’ensemble des principes de conception qui définissent la manière dont le processeur fonctionne et exécute les instructions. Elle détermine notamment le type d’instructions que le processeur peut comprendre, la manière dont les données sont manipulées et la façon dont les différents composants internes communiquent entre eux.

Il existe plusieurs architectures de processeurs, mais deux des plus répandues aujourd’hui sont x86 et ARM.

L’architecture x86 est principalement utilisée dans les ordinateurs personnels et les serveurs. Elle est notamment développée par des fabricants comme Intel et AMD. Cette architecture est conçue pour offrir de très bonnes performances et une grande compatibilité avec les logiciels utilisés sur les ordinateurs de bureau et les stations de travail.

L’architecture ARM, quant à elle, est très répandue dans les smartphones, tablettes et objets connectés. Elle est conçue pour consommer moins d’énergie tout en offrant de bonnes performances. Cette efficacité énergétique explique pourquoi elle est largement utilisée dans les appareils mobiles, où l’autonomie de la batterie est un facteur important.

Ces deux architectures reposent sur des approches différentes dans la conception des instructions et du matériel. L’architecture x86 utilise généralement un ensemble d’instructions plus complexe, tandis que l’architecture ARM privilégie un ensemble d’instructions plus simple et plus efficace en termes de consommation d’énergie.

Aujourd’hui, ces deux architectures coexistent et évoluent en permanence. On voit même apparaître des ordinateurs utilisant des processeurs ARM, ce qui montre que les frontières entre ces différentes architectures deviennent progressivement plus flexibles selon les besoins en performance, en consommation d’énergie et en compatibilité logicielle.

Les limites des processeurs modernes

Depuis plusieurs décennies, les processeurs n’ont cessé de devenir plus puissants. Les fabricants ont réussi à améliorer leurs performances en augmentant la fréquence d’horloge, en ajoutant davantage de cœurs et en réduisant la taille des composants électroniques. Cependant, cette progression se heurte aujourd’hui à plusieurs limites techniques et physiques.

L’une des principales contraintes concerne la chaleur produite par le processeur. Lorsqu’un processeur effectue un grand nombre de calculs, il consomme de l’électricité et génère de la chaleur. Si cette chaleur n’est pas correctement dissipée, le processeur peut surchauffer, ce qui risque d’endommager les composants ou de réduire les performances. C’est pour cette raison que les ordinateurs utilisent des systèmes de refroidissement, comme des dissipateurs thermiques ou des ventilateurs.

La consommation d’énergie constitue également un défi important. Plus un processeur est puissant, plus il peut consommer d’électricité. Cela pose notamment problème dans les appareils mobiles comme les smartphones et les ordinateurs portables, où l’autonomie de la batterie est un facteur essentiel.

Les fabricants doivent également faire face aux limites physiques des transistors. Les processeurs sont composés de milliards de transistors, de minuscules interrupteurs électroniques gravés dans le silicium. Depuis des années, les ingénieurs cherchent à réduire la taille de ces transistors afin d’en intégrer toujours plus sur une même puce. Cependant, à mesure que les composants deviennent extrêmement petits, il devient de plus en plus difficile de poursuivre cette miniaturisation.

Enfin, l’augmentation de la fréquence des processeurs a atteint certaines limites. Augmenter la vitesse d’horloge permet d’améliorer les performances, mais cela entraîne également une hausse importante de la chaleur et de la consommation d’énergie. C’est l’une des raisons pour lesquelles les fabricants ont privilégié ces dernières années l’ajout de plusieurs cœurs plutôt que l’augmentation continue de la fréquence.

Face à ces contraintes, les ingénieurs doivent trouver de nouvelles approches pour continuer à améliorer les performances des processeurs tout en maîtrisant la consommation d’énergie et la production de chaleur.

L’avenir des processeurs

L’évolution des processeurs ne s’arrête pas aux limites actuelles. Les chercheurs et les fabricants continuent d’explorer de nouvelles technologies pour améliorer les performances des ordinateurs tout en maîtrisant la consommation d’énergie et la production de chaleur.

L’une des tendances majeures est l’amélioration des architectures multicœurs. Les processeurs modernes possèdent déjà plusieurs cœurs capables de travailler en parallèle, et cette approche devrait continuer à se développer. Les fabricants cherchent à augmenter le nombre de cœurs tout en optimisant leur efficacité afin de mieux répartir les tâches entre les différentes unités de calcul.

Une autre piste importante concerne les processeurs spécialisés. Au lieu de confier tous les calculs au processeur principal, certaines tâches peuvent être prises en charge par des composants dédiés. Par exemple, les GPU sont très efficaces pour le traitement graphique et certains calculs massivement parallèles, tandis que les accélérateurs d’intelligence artificielle sont conçus pour traiter plus rapidement les algorithmes d’apprentissage automatique.

Les progrès dans les technologies de fabrication jouent également un rôle clé. Les fabricants continuent de réduire la taille des transistors afin d’augmenter le nombre de composants intégrés sur une puce. Ces avancées permettent d’améliorer les performances tout en réduisant la consommation d’énergie.

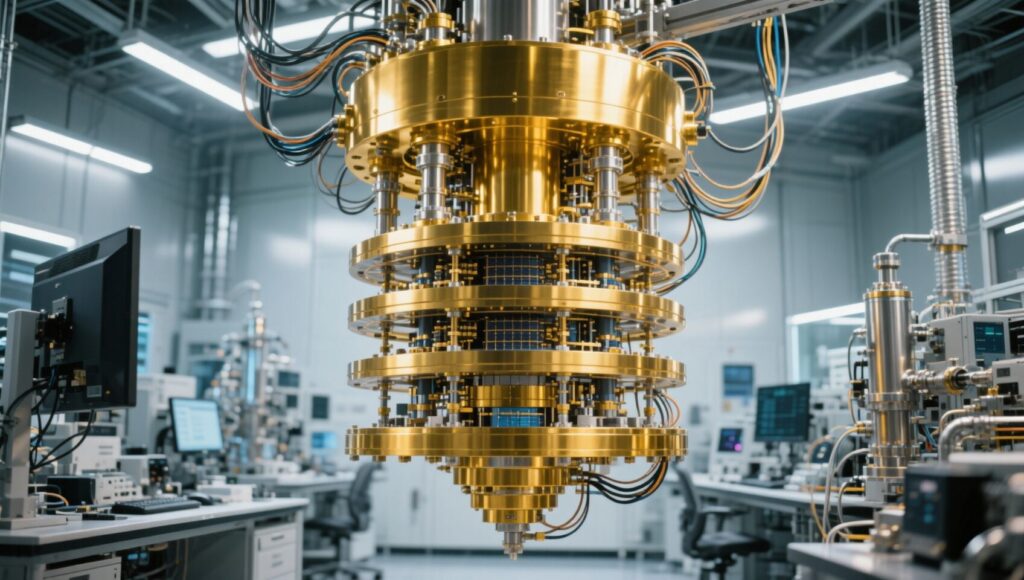

Par ailleurs, de nouvelles approches sont étudiées pour dépasser les limites des architectures traditionnelles. Des technologies comme les processeurs quantiques, les processeurs neuromorphiques inspirés du fonctionnement du cerveau ou encore les architectures basées sur des empilements de puces pourraient ouvrir la voie à de nouvelles générations de systèmes informatiques.

Si vous souhaitez en savoir plus sur les ordinateurs quantiques, je vous conseille de lire mon article sur le sujet.

Même si ces innovations sont encore en développement, elles montrent que l’évolution des processeurs est loin d’être terminée. Les progrès dans ce domaine continueront à jouer un rôle essentiel dans l’amélioration des performances des ordinateurs et dans le développement de nouvelles applications technologiques.

Conclusion

Le processeur est l’un des composants les plus essentiels d’un ordinateur. C’est lui qui exécute les instructions des programmes, réalise les calculs nécessaires et coordonne le fonctionnement des différents éléments du système. Sans processeur, aucun logiciel ne pourrait fonctionner et aucun traitement de données ne serait possible.

Dans cet article, nous avons vu que le processeur repose sur plusieurs composants internes, comme l’unité de contrôle, l’unité arithmétique et logique, les registres ou encore la mémoire cache. Ces éléments travaillent ensemble pour permettre au processeur de lire, comprendre et exécuter les instructions contenues dans les programmes.

Nous avons également découvert comment fonctionne le cycle d’exécution des instructions, qui permet au processeur de récupérer, décoder et exécuter des milliards d’instructions chaque seconde. La fréquence d’horloge, le nombre de cœurs et l’utilisation de la mémoire cache jouent également un rôle important dans les performances globales d’un processeur.

Malgré les progrès réalisés, les processeurs modernes doivent faire face à plusieurs défis, notamment les limites liées à la consommation d’énergie, à la chaleur et à la miniaturisation des transistors. Ces contraintes poussent les fabricants et les chercheurs à explorer de nouvelles solutions pour continuer à améliorer les performances des systèmes informatiques.

L’évolution des processeurs reste donc un domaine clé de l’innovation technologique. Les avancées futures dans ce domaine auront un impact direct sur les performances des ordinateurs, des smartphones et de nombreux autres appareils numériques qui font désormais partie de notre quotidien.